رئیس گروه حفاظت از بشریت اُپنایآی استعفا کرد

به گزارش خبرنگار علم و فناوری خبرگزاری برنا؛ در تابستان سال ۲۰۲۳، شرکت هوشمصنوعی(OpenAI) یک گروه ابرتنظیم(Superalignment) ایجاد کرد که هدف آن هدایت و کنترل سیستمهای هوش مصنوعی آینده بود که میتوانند آن قدر قدرتمند باشند که منجر به انقراض بشر شوند. کمتر از یک سال بعد، این گروه منحل شد.

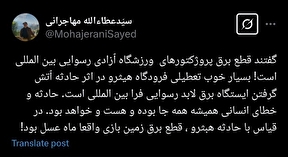

شرکت OpenAI اعلام کرد که این شرکت در حال ادغام گروه در تلاشهای تحقیقاتی خود برای کمک به شرکت در دستیابی به اهداف ایمنی خود است، اما مجموعهای از توییتهای جان لیک (Jan Leike)، یکی از رهبران تیم که به تازگی استعفا داده، تنشهای داخلی بین تیم ایمنی و شرکت را فاش کرده است.

در بیانیهای که در روز جمعه در شبکه اجتماعی ایکس منتشر شد، لیک گفت که تیم ابرتنظیم برای به دست آوردن منابع برای انجام تحقیقات مبارزه کرده است. وی نوشت: «ساخت دستگاههای هوشمندتر از انسان، یک تلاش ذاتا خطرناک است. مسئولیت بزرگی را از طرف تمام بشریت بر عهده دارد، اما در طول سالهای گذشته، فرهنگ ایمنی و فرآیندها اهمیت خود را از دست داده است.«

انتهای پیام/